注意

點擊這裡以下載完整的範例程式碼

音訊特徵提取¶

作者:Moto Hira

torchaudio 實現了音訊領域中常用的特徵提取。它們可在 torchaudio.functional 和 torchaudio.transforms 中使用。

functional 將特徵實現為獨立函數。它們是無狀態的。

transforms 將特徵實現為物件,使用 functional 和 torch.nn.Module 中的實現。它們可以使用 TorchScript 序列化。

import torch

import torchaudio

import torchaudio.functional as F

import torchaudio.transforms as T

print(torch.__version__)

print(torchaudio.__version__)

import librosa

import matplotlib.pyplot as plt

2.6.0

2.6.0

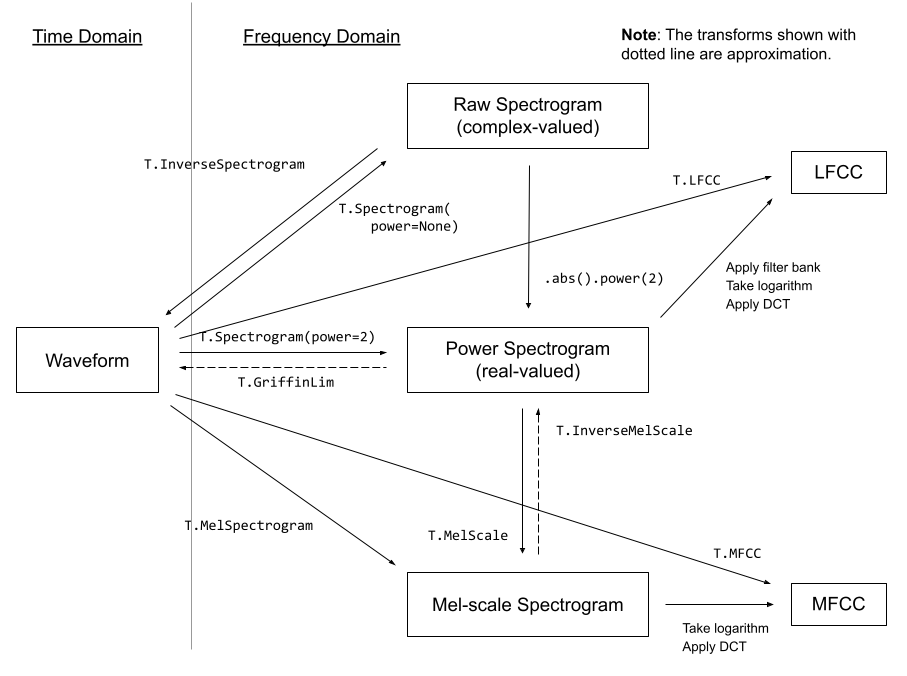

音訊特徵概觀¶

下圖顯示了常見音訊特徵與用於產生它們的 torchaudio API 之間的關係。

有關可用特徵的完整清單,請參閱文件。

準備¶

注意

在 Google Colab 中執行本教學課程時,請安裝所需的套件

!pip install librosa

from IPython.display import Audio

from matplotlib.patches import Rectangle

from torchaudio.utils import download_asset

torch.random.manual_seed(0)

SAMPLE_SPEECH = download_asset("tutorial-assets/Lab41-SRI-VOiCES-src-sp0307-ch127535-sg0042.wav")

def plot_waveform(waveform, sr, title="Waveform", ax=None):

waveform = waveform.numpy()

num_channels, num_frames = waveform.shape

time_axis = torch.arange(0, num_frames) / sr

if ax is None:

_, ax = plt.subplots(num_channels, 1)

ax.plot(time_axis, waveform[0], linewidth=1)

ax.grid(True)

ax.set_xlim([0, time_axis[-1]])

ax.set_title(title)

def plot_spectrogram(specgram, title=None, ylabel="freq_bin", ax=None):

if ax is None:

_, ax = plt.subplots(1, 1)

if title is not None:

ax.set_title(title)

ax.set_ylabel(ylabel)

ax.imshow(librosa.power_to_db(specgram), origin="lower", aspect="auto", interpolation="nearest")

def plot_fbank(fbank, title=None):

fig, axs = plt.subplots(1, 1)

axs.set_title(title or "Filter bank")

axs.imshow(fbank, aspect="auto")

axs.set_ylabel("frequency bin")

axs.set_xlabel("mel bin")

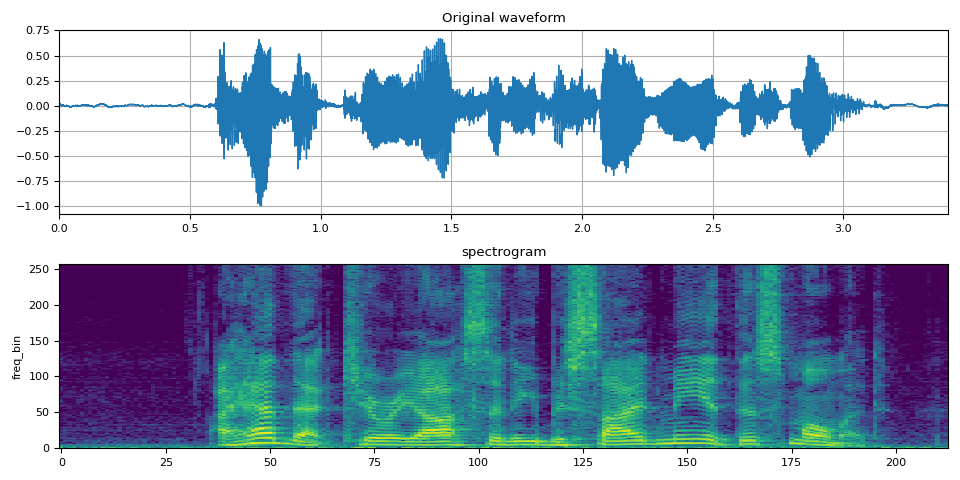

頻譜圖¶

若要取得音訊訊號的頻率組成隨時間變化的資訊,您可以使用 torchaudio.transforms.Spectrogram()。

# Load audio

SPEECH_WAVEFORM, SAMPLE_RATE = torchaudio.load(SAMPLE_SPEECH)

# Define transform

spectrogram = T.Spectrogram(n_fft=512)

# Perform transform

spec = spectrogram(SPEECH_WAVEFORM)

fig, axs = plt.subplots(2, 1)

plot_waveform(SPEECH_WAVEFORM, SAMPLE_RATE, title="Original waveform", ax=axs[0])

plot_spectrogram(spec[0], title="spectrogram", ax=axs[1])

fig.tight_layout()

Audio(SPEECH_WAVEFORM.numpy(), rate=SAMPLE_RATE)

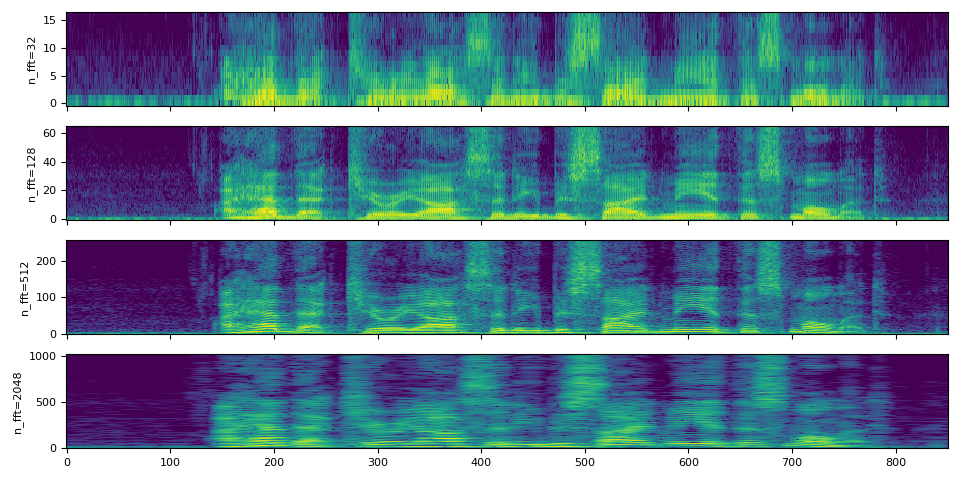

n_fft 參數的影響¶

頻譜圖計算的核心是(短時)傅立葉轉換,而 n_fft 參數對應於離散傅立葉轉換的以下定義中的 \(N\)。

$$ X_k = \sum_{n=0}^{N-1} x_n e^{-\frac{2\pi i}{N} nk} $$

(關於傅立葉轉換的詳細資訊,請參考 維基百科。)

n_fft 的值決定了頻率軸的解析度。然而,隨著 n_fft 值越高,能量將分佈在更多的頻率倉 (bin) 之中,因此當您視覺化它時,它可能看起來更模糊,即使它們具有更高的解析度。

以下說明了這一點:

注意

hop_length 決定了時間軸的解析度。預設情況下(即 hop_length=None 和 win_length=None),會使用 n_fft // 4 的值。這裡我們在不同的 n_fft 中使用相同的 hop_length 值,以便它們在時間軸上具有相同數量的元素。

n_ffts = [32, 128, 512, 2048]

hop_length = 64

specs = []

for n_fft in n_ffts:

spectrogram = T.Spectrogram(n_fft=n_fft, hop_length=hop_length)

spec = spectrogram(SPEECH_WAVEFORM)

specs.append(spec)

在比較訊號時,最好使用相同的採樣率,但是如果您必須使用不同的採樣率,則必須小心解釋 n_fft 的含義。回想一下,n_fft 決定了給定採樣率下頻率軸的解析度。換句話說,頻率軸上每個頻率倉 (bin) 代表的意義取決於採樣率。

正如我們上面所看到的,對於相同的輸入訊號,更改 n_fft 的值不會更改頻率範圍的覆蓋範圍。

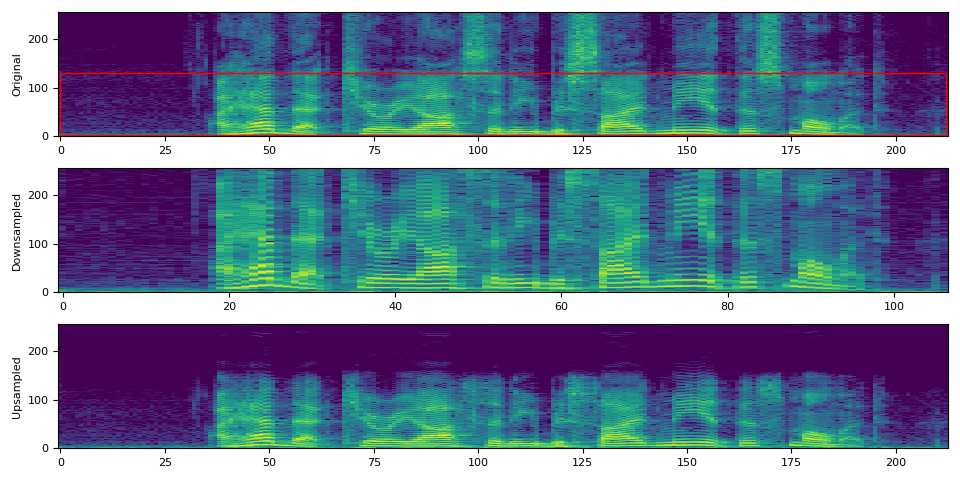

讓我們對音訊進行降採樣,並使用相同的 n_fft 值應用頻譜圖。

# Downsample to half of the original sample rate

speech2 = torchaudio.functional.resample(SPEECH_WAVEFORM, SAMPLE_RATE, SAMPLE_RATE // 2)

# Upsample to the original sample rate

speech3 = torchaudio.functional.resample(speech2, SAMPLE_RATE // 2, SAMPLE_RATE)

# Apply the same spectrogram

spectrogram = T.Spectrogram(n_fft=512)

spec0 = spectrogram(SPEECH_WAVEFORM)

spec2 = spectrogram(speech2)

spec3 = spectrogram(speech3)

# Visualize it

fig, axs = plt.subplots(3, 1)

plot_spectrogram(spec0[0], ylabel="Original", ax=axs[0])

axs[0].add_patch(Rectangle((0, 3), 212, 128, edgecolor="r", facecolor="none"))

plot_spectrogram(spec2[0], ylabel="Downsampled", ax=axs[1])

plot_spectrogram(spec3[0], ylabel="Upsampled", ax=axs[2])

fig.tight_layout()

在上面的視覺化中,第二個圖(“Downsampled”)可能會給人頻譜圖被拉伸的印象。這是因為頻率倉 (bin) 的含義與原始的不同。即使它們具有相同數量的頻率倉 (bin),在第二個圖中,頻率僅覆蓋到原始採樣率的一半。如果我們再次對降採樣後的訊號進行重新採樣,使其具有與原始訊號相同的採樣率,這將變得更加清楚。

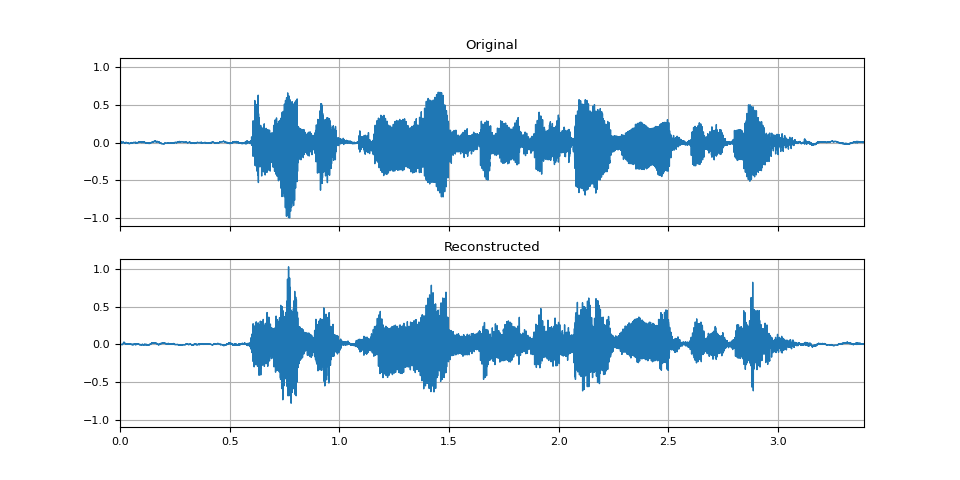

GriffinLim¶

要從頻譜圖恢復波形,您可以使用 torchaudio.transforms.GriffinLim。

必須使用與頻譜圖相同的一組參數。

# Define transforms

n_fft = 1024

spectrogram = T.Spectrogram(n_fft=n_fft)

griffin_lim = T.GriffinLim(n_fft=n_fft)

# Apply the transforms

spec = spectrogram(SPEECH_WAVEFORM)

reconstructed_waveform = griffin_lim(spec)

_, axes = plt.subplots(2, 1, sharex=True, sharey=True)

plot_waveform(SPEECH_WAVEFORM, SAMPLE_RATE, title="Original", ax=axes[0])

plot_waveform(reconstructed_waveform, SAMPLE_RATE, title="Reconstructed", ax=axes[1])

Audio(reconstructed_waveform, rate=SAMPLE_RATE)

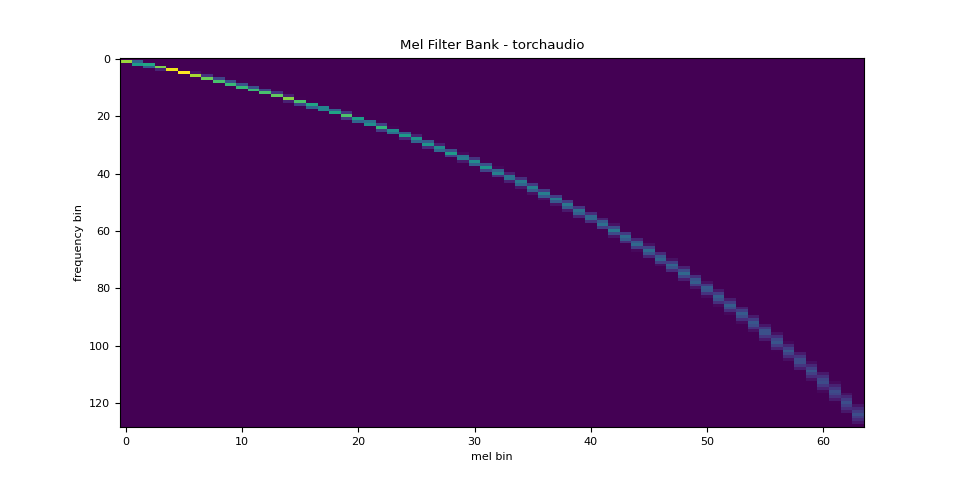

梅爾濾波器組 (Mel Filter Bank)¶

torchaudio.functional.melscale_fbanks() 產生用於將頻率倉 (bin) 轉換為梅爾尺度 (mel-scale) 倉 (bin) 的濾波器組。

由於此函數不需要輸入音訊/特徵,因此在 torchaudio.transforms() 中沒有等效的轉換。

n_fft = 256

n_mels = 64

sample_rate = 6000

mel_filters = F.melscale_fbanks(

int(n_fft // 2 + 1),

n_mels=n_mels,

f_min=0.0,

f_max=sample_rate / 2.0,

sample_rate=sample_rate,

norm="slaney",

)

plot_fbank(mel_filters, "Mel Filter Bank - torchaudio")

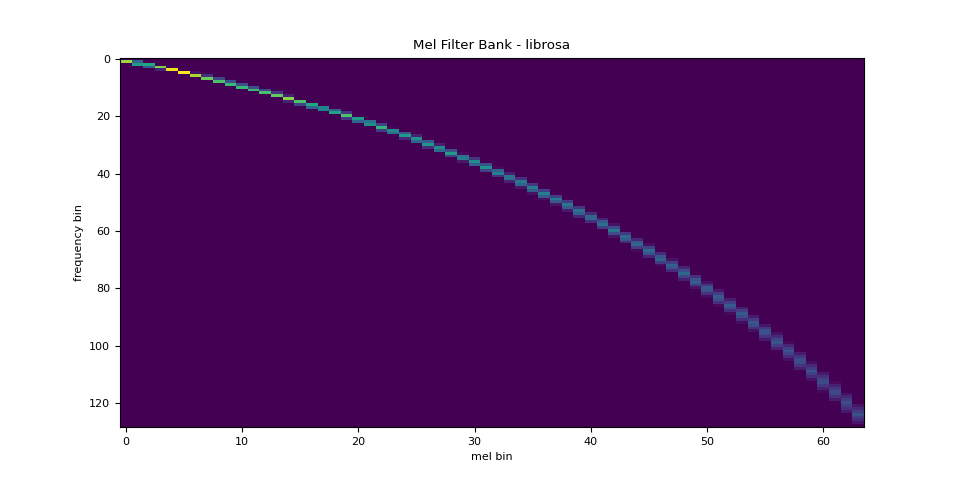

與 librosa 的比較¶

作為參考,這裡是用 librosa 獲取梅爾濾波器組的等效方法。

mel_filters_librosa = librosa.filters.mel(

sr=sample_rate,

n_fft=n_fft,

n_mels=n_mels,

fmin=0.0,

fmax=sample_rate / 2.0,

norm="slaney",

htk=True,

).T

plot_fbank(mel_filters_librosa, "Mel Filter Bank - librosa")

mse = torch.square(mel_filters - mel_filters_librosa).mean().item()

print("Mean Square Difference: ", mse)

Mean Square Difference: 3.934872696751886e-17

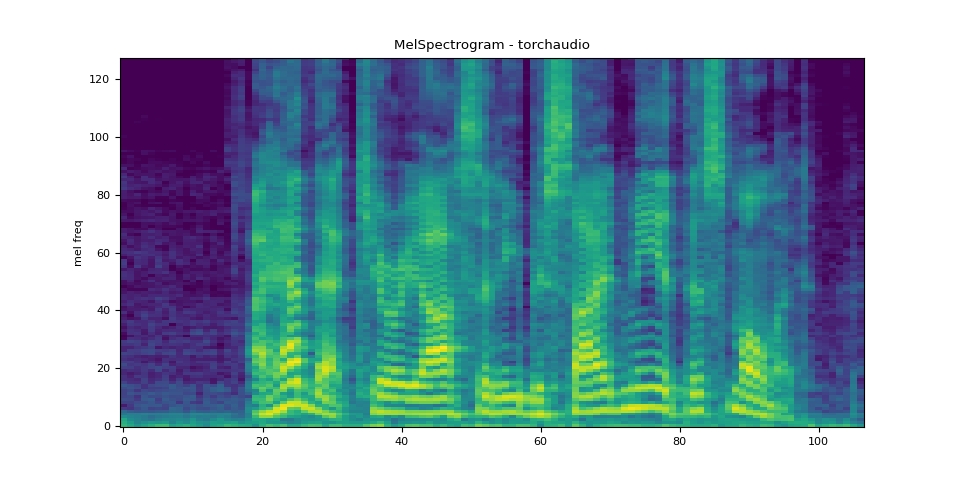

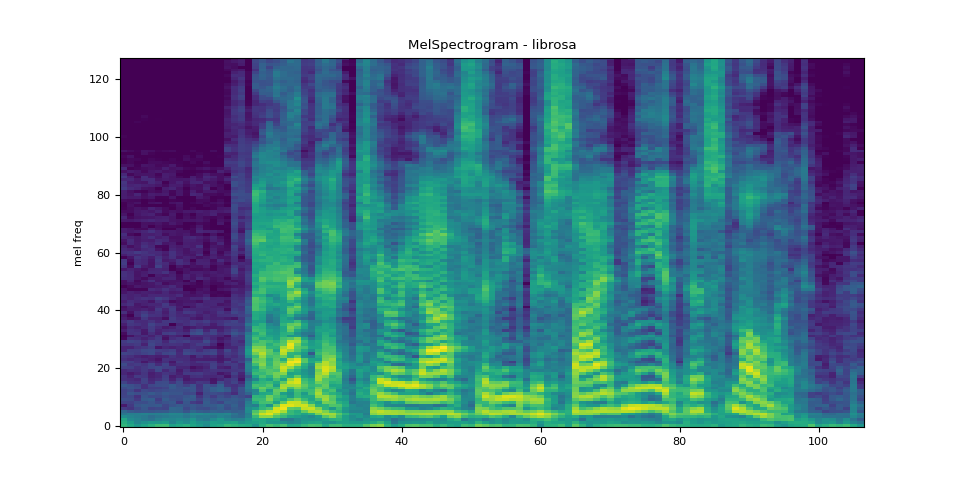

MelSpectrogram¶

產生梅爾尺度頻譜圖涉及產生頻譜圖並執行梅爾尺度轉換。在 torchaudio 中,torchaudio.transforms.MelSpectrogram() 提供了此功能。

n_fft = 1024

win_length = None

hop_length = 512

n_mels = 128

mel_spectrogram = T.MelSpectrogram(

sample_rate=sample_rate,

n_fft=n_fft,

win_length=win_length,

hop_length=hop_length,

center=True,

pad_mode="reflect",

power=2.0,

norm="slaney",

n_mels=n_mels,

mel_scale="htk",

)

melspec = mel_spectrogram(SPEECH_WAVEFORM)

plot_spectrogram(melspec[0], title="MelSpectrogram - torchaudio", ylabel="mel freq")

與 librosa 的比較¶

作為參考,這裡是用 librosa 產生梅爾尺度頻譜圖的等效方法。

melspec_librosa = librosa.feature.melspectrogram(

y=SPEECH_WAVEFORM.numpy()[0],

sr=sample_rate,

n_fft=n_fft,

hop_length=hop_length,

win_length=win_length,

center=True,

pad_mode="reflect",

power=2.0,

n_mels=n_mels,

norm="slaney",

htk=True,

)

plot_spectrogram(melspec_librosa, title="MelSpectrogram - librosa", ylabel="mel freq")

mse = torch.square(melspec - melspec_librosa).mean().item()

print("Mean Square Difference: ", mse)

Mean Square Difference: 1.2895221557229775e-09

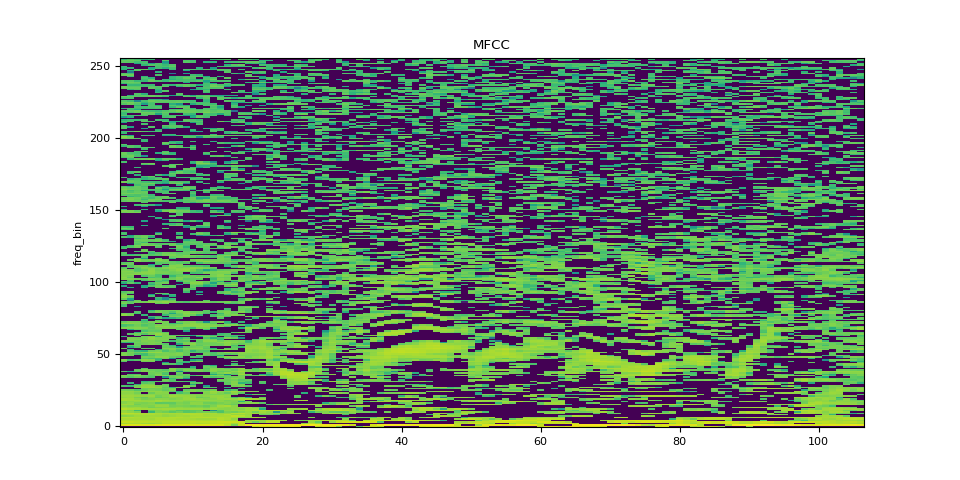

MFCC¶

n_fft = 2048

win_length = None

hop_length = 512

n_mels = 256

n_mfcc = 256

mfcc_transform = T.MFCC(

sample_rate=sample_rate,

n_mfcc=n_mfcc,

melkwargs={

"n_fft": n_fft,

"n_mels": n_mels,

"hop_length": hop_length,

"mel_scale": "htk",

},

)

mfcc = mfcc_transform(SPEECH_WAVEFORM)

plot_spectrogram(mfcc[0], title="MFCC")

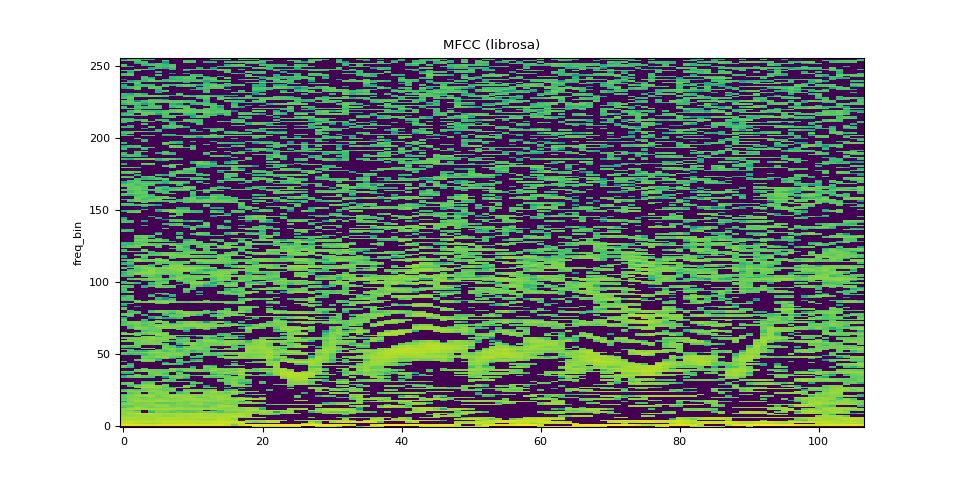

與 librosa 的比較¶

melspec = librosa.feature.melspectrogram(

y=SPEECH_WAVEFORM.numpy()[0],

sr=sample_rate,

n_fft=n_fft,

win_length=win_length,

hop_length=hop_length,

n_mels=n_mels,

htk=True,

norm=None,

)

mfcc_librosa = librosa.feature.mfcc(

S=librosa.core.spectrum.power_to_db(melspec),

n_mfcc=n_mfcc,

dct_type=2,

norm="ortho",

)

plot_spectrogram(mfcc_librosa, title="MFCC (librosa)")

mse = torch.square(mfcc - mfcc_librosa).mean().item()

print("Mean Square Difference: ", mse)

Mean Square Difference: 0.8104011416435242

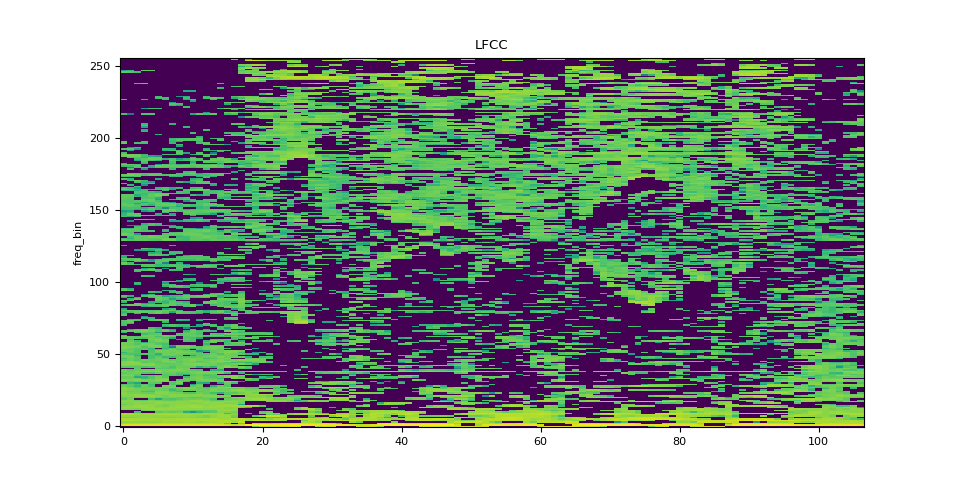

LFCC¶

n_fft = 2048

win_length = None

hop_length = 512

n_lfcc = 256

lfcc_transform = T.LFCC(

sample_rate=sample_rate,

n_lfcc=n_lfcc,

speckwargs={

"n_fft": n_fft,

"win_length": win_length,

"hop_length": hop_length,

},

)

lfcc = lfcc_transform(SPEECH_WAVEFORM)

plot_spectrogram(lfcc[0], title="LFCC")

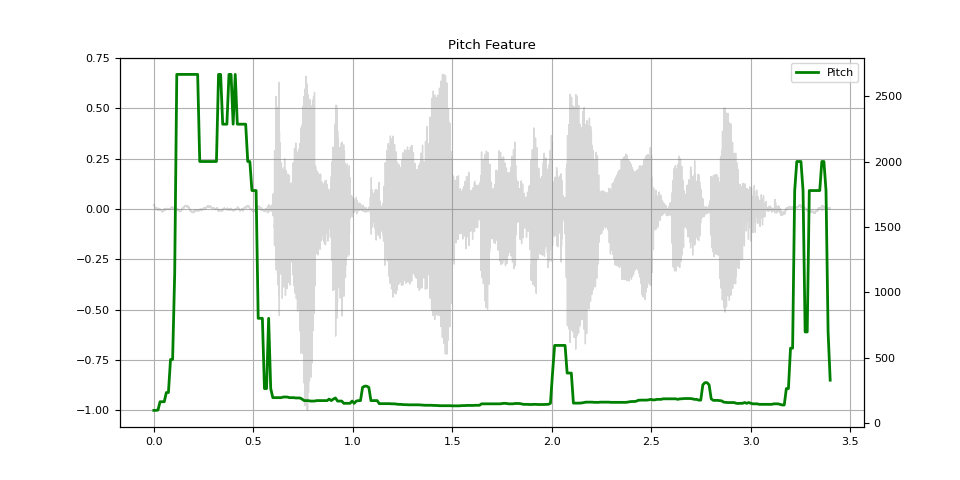

音高 (Pitch)¶

pitch = F.detect_pitch_frequency(SPEECH_WAVEFORM, SAMPLE_RATE)

def plot_pitch(waveform, sr, pitch):

figure, axis = plt.subplots(1, 1)

axis.set_title("Pitch Feature")

axis.grid(True)

end_time = waveform.shape[1] / sr

time_axis = torch.linspace(0, end_time, waveform.shape[1])

axis.plot(time_axis, waveform[0], linewidth=1, color="gray", alpha=0.3)

axis2 = axis.twinx()

time_axis = torch.linspace(0, end_time, pitch.shape[1])

axis2.plot(time_axis, pitch[0], linewidth=2, label="Pitch", color="green")

axis2.legend(loc=0)

plot_pitch(SPEECH_WAVEFORM, SAMPLE_RATE, pitch)

腳本的總運行時間:(0 分鐘 9.807 秒)